Cours d’apprentissage profond de la New York University

Edition 2021

Le cours de Yann LE CUN et Alfredo CANZIANI

traduit en français par Loïck BOURDOIS

Accueil

Bienvenue au cours sur les modèles de diffusion 🤗 !

À quoi s’attendre ?

Dans ce cours gratuit, vous allez :

- 👩🎓 Étudier la théorie des modèles de diffusion

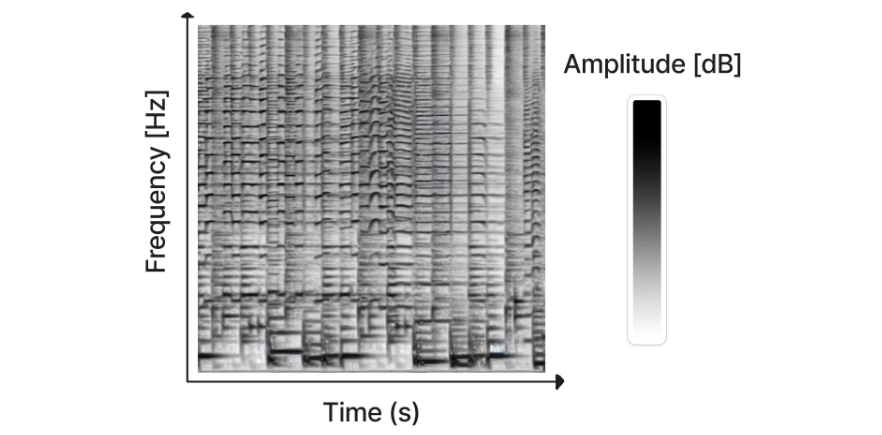

- 🧨 Apprendre à générer des images et de l’audio avec la bibliothèque populaire 🤗 Diffusers

- 🏋️♂️ Entraîner vos propres modèles de diffusion à partir de zéro

- 📻 Affiner des modèles de diffusion existants sur de nouveaux jeux de données

- 🗺 Explorer la génération conditionnelle et le guidage

- 🧑🔬 Créer vos propres pipelines de modèles de diffusion personnalisés

Prérequis

Ce cours requiert un bon niveau en Python et des bases en apprentissage profond et Pytorch. Si ce n’est pas encore le cas, vous pouvez consulter ces ressources gratuites (en anglais) :

- Python : https://www.udacity.com/course/introduction-to-python–ud1110

- Introduction à l’apprentissage profond avec PyTorch : https://www.udacity.com/course/deep-learning-pytorch–ud188

- PyTorch en 60 min : https://pytorch.org/tutorials/beginner/deep_learning_60min_blitz.html

Pour pousser vos modèles sur le Hub d’Hugging Face, vous aurez besoin d’un compte. Vous pouvez en créer un gratuitement à l’adresse suivante : https://huggingface.co/join.

Quel est le programme ?

Le cours est constitué de quatre unités. Chacune d’elle est composée d’une partie théorie listant également des ressources / papiers, ainsi que de deux notebooks. Plus précisément, nous avons :

- Unité 1 : Introduction aux modèles de diffusion

Introduction à 🤗 Diffusers et implémentation à partir de 0 - Unité 2 : Finetuning et guidage

Finetuner un modèle de diffusion sur de nouvelles données et ajout du guidage - Unité 3 : Stable Diffusion

Exploration d’un puissant modèle de diffusion latent conditionné par le texte - Unité 4 : Faire plus avec la diffusion

Techniques avancées pour aller plus loin dans la diffusion

Qui sommes-nous ?

À propos des auteurs de ce cours :

Jonathan Whitaker est TODO.

Lewis Tunstall est ingénieur en apprentissage machine chez Hugging Face et dévoué au développement d’outils open source avec la volonté de les rendre accessibles à une communauté plus large. Il est également co-auteur du livre Natural Language Processing with Transformers.

FAQ

Voici quelques réponses aux questions fréquemment posées :

-

Suivre ce cours mène-t-il à une certification ?

Actuellement, nous n’avons pas de certification pour ce cours. -

Combien de temps dois-je consacrer à ce cours ?

Chaque chapitre de ce cours est conçu pour être complété en une semaine, avec environ 6 à 8 heures de travail par unité. Cependant, vous pouvez prendre tout le temps nécessaire pour le suivre. -

Où puis-je poser une question si j’en ai une ?

Si vous avez une question sur l’une des sections du cours, il vous suffit de cliquer sur la bannière « Ask a question » en haut de la page pour être automatiquement redirigé vers le Discord de Hugging Face pour poser votre question dans le channel#diffusion-models-class.

- Où puis-je obtenir le code du cours ?

Pour chaque section, vous pouvez cliquer sur la bannière en haut de la page pour exécuter son code :

-

Comment puis-je contribuer au cours ?

Il existe de nombreuses façons de contribuer au cours ! Si vous trouvez une coquille ou un bug, veuillez ouvrir une « Issue » sur le dépôtdiffusion-models-class. Si vous souhaitez aider à traduire le cours dans votre langue maternelle, consultez les instructions ici. -

Peut-on réutiliser ce cours?

Bien sûr ! Le cours est publié sous la licence Apache 2 license. Cela signifie que vous devez créditer de manière appropriée, fournir un lien vers la licence et indiquer si des modifications ont été apportées. Vous pouvez le faire de toute manière raisonnable, mais pas d’une façon qui suggère que le distributeur de la licence vous approuve ou approuve votre utilisation. Si vous souhaitez citer le cours, veuillez utiliser le BibTeX suivant :

@misc{huggingfacecourse,

author = {Hugging Face},

title = {The Hugging Face Diffusion Models Course, 2022},

howpublished = "\url{https://huggingface.co/course}",

year = {2022},

note = "[Online; accessed <today>]"

}

C’est parti !

Êtes-vous prêt à commencer ? Alors rendez vous à la première unité pour débuter le cours.

1. Vue d'ensemble

Dans cette unité, vous apprendrez les bases de fonctionnement des modèles de diffusion et comment créer les vôtres à l’aide de la bibliothèque 🤗 Diffusers.

Vue d’ensemble de cette unité :rocket:

Les différentes étapes à suivre pour cette unité :

- Lisez le matériel d’introduction ci-dessous ainsi que toutes les ressources supplémentaires listées en bas de page qui vous sembleront intéressantes.

- Consultez le notebook Introduction à Diffusers pour mettre en pratique la théorie avec la bibliothèque 🤗 Diffusers.

- Entraînez et partagez votre propre modèle de diffusion en utilisant le notebook ou le script d’entraînement associé.

- (Facultatif) Approfondissez avec le notebook Implémentation à partir de 0 des modèles de diffusion à partir de zéro si vous souhaitez voir une implémentation minimale à partir de zéro et explorer les différentes décisions de conception en jeu.

- (Facultatif) Regardez cette vidéo (en anglais) pour une présentation informelle du matériel de cette unité.

Que sont les modèles de diffusion ?

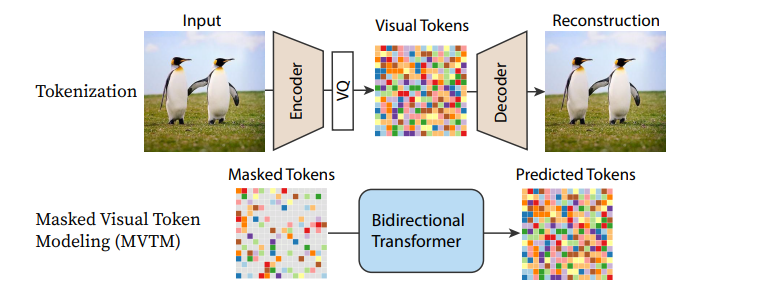

Les modèles de diffusion sont un ajout relativement récent à un groupe d’algorithmes connus sous le nom de modèles génératifs. L’objectif de la modélisation générative est d’apprendre à générer des données, telles que des images ou des sons, à partir d’un certain nombre d’exemples d’entraînement. Un bon modèle génératif créera un ensemble diversifié de sorties qui ressemblent aux données d’entraînement sans être des copies exactes. Comment les modèles de diffusion y parviennent-ils ? Concentrons-nous sur le cas de la génération d’images à des fins d’illustration.

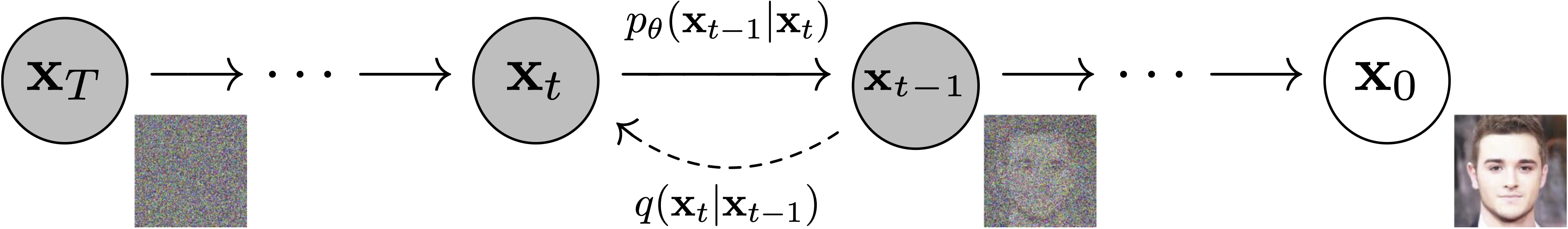

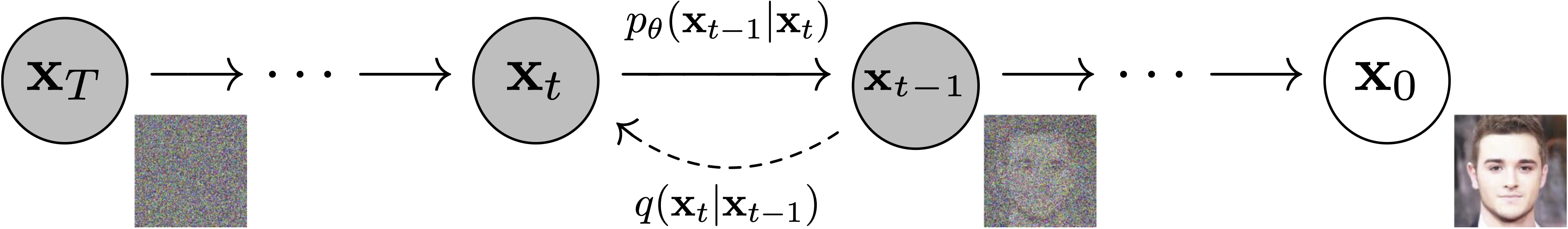

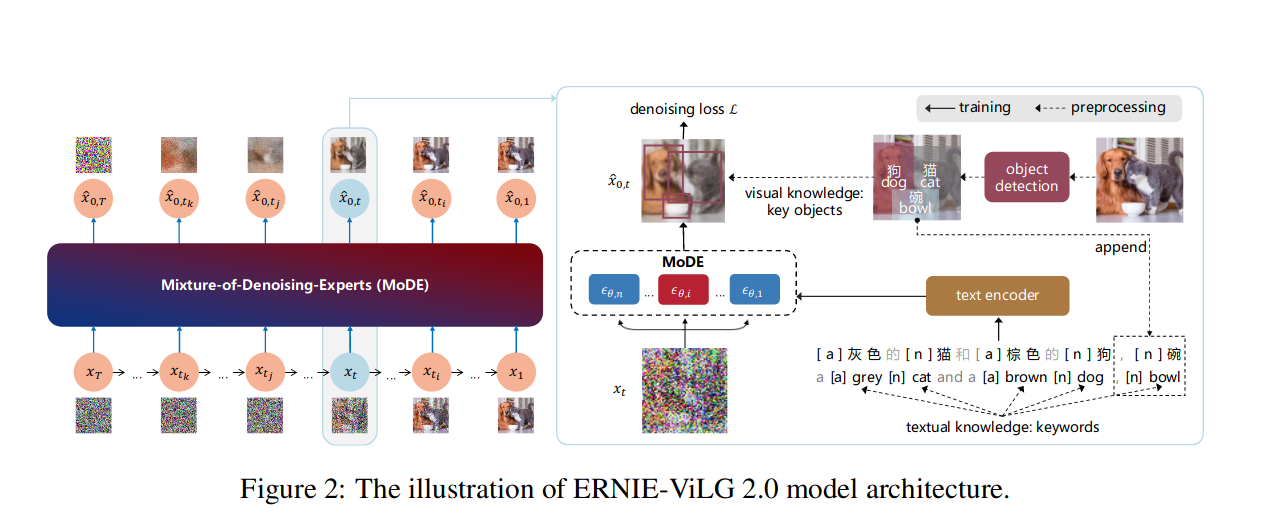

Figure tirée du papier DDPM de Ho et al. (2020) (https://arxiv.org/abs/2006.11239).

Le secret de la réussite des modèles de diffusion réside dans la nature itérative du processus de diffusion. La génération commence par un bruit aléatoire, mais celui-ci est progressivement affiné au cours d’un certain nombre d’étapes jusqu’à ce qu’une image de sortie émerge. À chaque étape, le modèle estime comment nous pourrions passer de l’entrée actuelle x_t à une version complètement débruitée x_0. Cependant, comme nous n’effectuons qu’un petit changement à chaque étape t, toute erreur dans cette estimation aux premiers stades (où il est extrêmement difficile de prédire le résultat final) peut être corrigée dans les mises à jour ultérieures.

Entraîner le modèle est relativement simple par rapport à d’autres types de modèles génératifs. Nous procédons de manière répétée 1) Nous chargeons quelques images à partir des données d’entraînement. 2) Nous ajoutons du bruit, en différentes quantités. N’oubliez pas que nous voulons que le modèle soit capable d’estimer comment « corriger » (débruiter) à la fois des images extrêmement bruitées et des images qui sont proches de la perfection. 3) Nous introduisons les versions bruitées des données d’entrée dans le modèle. 4) Nous évaluons l’efficacité du modèle à débruiter ces données d’entrée. 5) Nous utilisons ces informations pour mettre à jour les poids du modèle.

Pour générer de nouvelles images à l’aide d’un modèle entraîné, nous commençons par une entrée totalement aléatoire que nous soumettons au modèle de manière répétée, en l’actualisant à chaque fois d’une petite quantité basée sur la prédiction du modèle. Comme nous le verrons, il existe un certain nombre de méthodes d’échantillonnage qui tentent de rationaliser ce processus afin de générer de bonnes images en un minimum d’étapes.

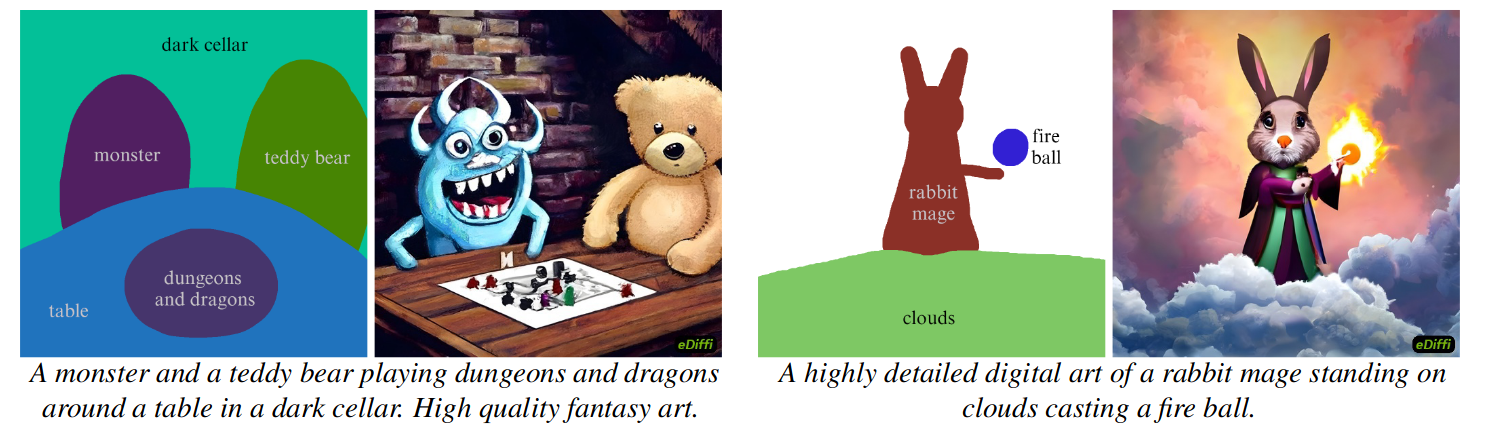

Nous montrerons chacune de ces étapes en détail dans les notebooks de l’unité 1. Dans l’unité 2, nous verrons comment ce processus peut être modifié pour ajouter un contrôle supplémentaire sur les résultats du modèle par le biais d’un conditionnement supplémentaire (tel qu’une étiquette de classe) ou de techniques telles que le guidage. Les unités 3 et 4 exploreront un modèle de diffusion extrêmement puissant appelé Stable Diffusion, qui peut générer des images à partir de descriptions textuelles.

Notebooks

A ce stade, vous en savez assez pour vous lancer dans les notebooks de cette unité ! Les deux notebooks abordent la même idée de manière différente.

| Chapitre | Colab | Kaggle | Gradient | Studio Lab |

|---|---|---|---|---|

| Introduction à Diffusers |  |

|

||

| Implémentation à partir de 0 |  |

|

Dans Introduction à Diffusers, nous montrons les différentes étapes décrites ci-dessus en utilisant les blocs de la bibliothèque 🤗 Diffusers. Vous verrez rapidement comment créer, entraîner et échantillonner vos propres modèles de diffusion sur les données de votre choix. À la fin du notebook, vous serez en mesure de lire et de modifier le script d’entraînement illustratif pour entraîner des modèles de diffusion et les partager avec le monde entier ! Ce notebook introduit également l’exercice principal associé à cette unité, où nous tenterons collectivement de trouver de bonnes « recettes d’entraînement » pour les modèles de diffusion à différentes échelles (voir la section suivante pour plus d’informations).

Dans Modèles de diffusion à partir de 0, nous montrons ces mêmes étapes (ajout de bruit aux données, création d’un modèle, entraînement et échantillonnage) mais implémentées à partir de zéro dans PyTorch aussi simplement que possible. Nous comparons ensuite cet « exemple-jouet » avec la version de 🤗 Diffusers, en notant les différences entre les deux et les améliorations qui ont été apportées. L’objectif est de se familiariser avec les différents composants et les décisions de conception qui les sous-tendent, afin de pouvoir identifier rapidement les idées clés pour une nouvelle implémentation.

Projet

Une fois les bases assimilées grâce aux notebooks, essayez d’entraîner un ou plusieurs modèles de diffusion ! Quelques suggestions sont incluses à la fin du notebook Introduction à Diffusers. N’oubliez pas de partager vos résultats, vos recettes d’entraînement et vos découvertes avec la communauté afin que nous puissions trouver ensemble les meilleures façons d’entraîner ces modèles.

Ressources complémentaires

Une liste non exhaustive de ressources (en anglais) à consulter :

- Le modèle de diffusion annoté est une présentation très approfondie du code et de la théorie qui sous-tend les DDPM, avec des mathématiques et du code montrant tous les différents composants. Il liste également un certain nombre d’articles pour une lecture plus approfondie.

- La documentation d’Hugging Face sur la Génération d’images inconditionnelle contient des exemples d’entraînement de modèles de diffusion à l’aide du script d’entraînement officiel, y compris le code montrant comment créer votre propre jeu de données.

- La vidéo d’AI Coffee Break sur les modèles de diffusion

- La vidéo de Yannic Kilcher sur les DDPM

Vous avez identifié d’autres ressources intéressantes ? Faites-le nous savoir et nous les ajouterons à cette liste.

1.1. Introduction à 🤗 Diffusers

Dans ce notebook, vous allez entraîner votre premier modèle de diffusion pour générer des images de mignons papillons 🦋. En cours de route, vous apprendrez les composants de base de la bibliothèque 🤗 Diffusers, qui fournira une bonne assise pour les applications plus avancées que nous couvrirons plus tard dans le cours.

Débutons par une vue d’ensemble de ce qu’on va faire dans ce notebook. Nous allons :

- Voir un puissant pipeline de modèles de diffusion personnalisé en action (avec des informations sur la façon de créer votre propre version).

- Créer votre propre mini-pipeline en :

- Récapitulant les idées principales derrière les modèles de diffusion

- Chargement de données à partir du Hub pour l’entraînement

- Explorer comment ajouter du bruit à ces données à l’aide d’un planificateur

- Créer et entraîner le modèle UNet

- Rassembler les pièces du puzzle pour en faire un pipeline fonctionnel

- Éditer et exécuter un script pour initialiser des séries d’entraînement plus longues, qui gèrera

- Entraînement multi-GPU via 🤗 Accelerate

- Journalisation de l’expérience pour suivre les statistiques critiques

- Téléchargement du modèle final sur le Hub d’Hugging Face

Installation des bibliothèques

Exécutez la cellule suivante pour installer la bibliothèque 🤗 Diffusers ainsi que quelques autres prérequis :

%pip install -qq -U diffusers datasets transformers accelerate ftfy pyarrow==9.0.0

Ensuite, rendez-vous sur https://huggingface.co/settings/tokens et créez un tokens d’accès avec autorisation d’écriture si vous n’en avez pas déjà un :

Vous pouvez vous connecter avec ce token en utilisant la ligne de commande (huggingface-cli login) ou en exécutant la cellule suivante :

from huggingface_hub import notebook_login

notebook_login()

Vous devez ensuite installer Git-LFS pour télécharger les checkpoints de votre modèle :

%%capture

!sudo apt -qq install git-lfs

!git config --global credential.helper store

Enfin, importons les bibliothèques que nous utiliserons et définissons quelques fonctions de confort que nous utiliserons plus tard dans le notebook :

import numpy as np

import torch

import torch.nn.functional as F

from matplotlib import pyplot as plt

from PIL import Image

def show_images(x):

"""Étant donné un lot d'images x, faire une grille et convertir en PIL"""

x = x * 0.5 + 0.5 # On va de (-1, 1) et revenons (0, 1)

grid = torchvision.utils.make_grid(x)

grid_im = grid.detach().cpu().permute(1, 2, 0).clip(0, 1) * 255

grid_im = Image.fromarray(np.array(grid_im).astype(np.uint8))

return grid_im

def make_grid(images, size=64):

"""Étant donné une liste d'images PIL, les empiler en une ligne pour faciliter la visualisation."""

output_im = Image.new("RGB", (size * len(images), size))

for i, im in enumerate(images):

output_im.paste(im.resize((size, size)), (i * size, 0))

return output_im

# Les utilisateurs de Mac peuvent avoir besoin de device = 'mps' (non testé)

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

OK, nous sommes prêts !

Exemple générique d’inférence avec Dreambooth, un avant-goût de ce qui nous attend

Si vous avez un tant soit peu consulté les médias sociaux au cours des derniers mois, vous avez certainement entendu parler de Stable Diffusion. Il s’agit d’un puissant modèle de diffusion latent conditionné par le texte (ne vous inquiétez pas, nous allons apprendre ce que cela signifie). Mais il a un défaut : il ne sait pas à quoi vous ou moi ressemblons, à moins que nous soyons suffisamment célèbres pour que nos images soient répandues sur internet.

Dreambooth nous permet de créer notre propre variante de modèle avec une connaissance supplémentaire d’un visage, d’un objet ou d’un style spécifique. Le Corridor Crew a réalisé une excellente vidéo (en anglais) en utilisant cette technique pour raconter des histoires avec des personnages cohérents, ce qui est un excellent exemple de ce que cette technique peut faire :

from IPython.display import YouTubeVideo

YouTubeVideo("W4Mcuh38wyM")

Voici un exemple d’une sortie d’un modèle entraîné sur 5 photos du jouet Monsieur Patate.

Tout d’abord, nous chargeons le pipeline. Ceci télécharge les poids du modèle depuis le Hub. Étant donné que plusieurs gigaoctets de données sont téléchargés pour une démonstration d’une ligne, vous pouvez sauter cette cellule et simplement admirer la sortie de l’exemple !

from diffusers import StableDiffusionPipeline

# Consultez https://huggingface.co/sd-dreambooth-library pour découvrir de nombreux modèles provenant de la communauté

model_id = "sd-dreambooth-library/mr-potato-head"

# Chargement du pipeline

pipe = StableDiffusionPipeline.from_pretrained(model_id, torch_dtype=torch.float16).to(

device

)

Une fois le chargement du pipeline terminé, nous pouvons générer des images avec :

prompt = "an abstract oil painting of sks mr potato head by picasso"

image = pipe(prompt, num_inference_steps=50, guidance_scale=7.5).images[0]

image

✏️ À votre tour ! Essayez vous-même avec des prompts différents. Le token

sksreprésente un identifiant unique pour le nouveau concept : que se passe-t-il si vous l’omettez ? Vous pouvez aussi expérimenter en changeant le nombre de pas d’échantillonnage (jusqu’où pouvez-vous descendre ?) et le paramètreguidance_scale, qui détermine jusqu’à quel point le modèle va essayer de correspondre au prompt.Il se passe beaucoup de choses dans ce pipeline ! À la fin du cours, vous saurez comment tout cela fonctionne. Pour l’instant, voyons comment nous pouvons entraîner un modèle de diffusion à partir de zéro.

MVP (Minimum Viable Pipeline)

Exemple d’inférence sur les papillons

L’API de base de 🤗 Diffusers est divisée en trois composants principaux :

- Pipelines : classes de haut niveau conçues pour générer rapidement des échantillons à partir de modèles de diffusion populaires entraînés de manière conviviale.

- Models : architectures populaires pour entraîner de nouveaux modèles de diffusion, par exemple UNet.

- Schedulers : diverses techniques pour générer des images à partir du bruit pendant l’inférence ainsi que pour générer des images bruitées pour l’entraînement.

Les pipelines sont parfaits pour les utilisateurs finaux, mais si vous êtes ici pour ce cours, nous supposons que vous voulez savoir ce qui se passe sous le capot ! Dans le reste de ce notebook, nous allons donc construire notre propre pipeline capable de générer de petites images de papillons. Voici le résultat final en action :

from diffusers import DDPMPipeline

# Chargement du pipeline de papillons

butterfly_pipeline = DDPMPipeline.from_pretrained(

"johnowhitaker/ddpm-butterflies-32px"

).to(device)

# Création de 8 images

images = butterfly_pipeline(batch_size=8).images

# Visualisation du résultat

make_grid(images)

Ce n’est peut-être pas aussi impressionnant que l’exemple de DreamBooth, mais nous entraînons notre modèle à partir de zéro avec ~0,0001% des données utilisées pour entraîner Stable Diffusion. En parlant d’entraînement, rappelez-vous que l’entraînement d’un modèle de diffusion ressemble à ceci :

- Chargement de quelques images à partir des données entraînées.

- Ajout de bruit, en différentes quantités.

- Introduction des versions bruitées des données d’entrée dans le modèle.

- Évaluation de la capacité du modèle à débruiter ces données d’entrée

- Utilisation de ces informations pour mettre à jour les poids du modèle, et répétition.

Nous allons explorer ces étapes une par une dans les prochaines parties jusqu’à ce que nous ayons une boucle d’entraînement complète, puis nous verrons comment échantillonner à partir du modèle entraîné et comment regrouper le tout dans un pipeline pour faciliter le partage. Commençons par les données.

Télécharger le jeu de données d’entraînement

Pour cet exemple, nous utilisons un jeu de données d’images provenant du Hub d’Hugging Face. Plus précisément, cette collection de 1000 images de papillons. Il s’agit d’un très petit jeu de données, c’est pourquoi nous avons aussi inclus des lignes en commentaires pour quelques options plus importantes. Si vous préférez utiliser votre propre collection d’images, vous pouvez également utiliser l’exemple de code commenté pour charger des images à partir d’un dossier.

import torchvision

from datasets import load_dataset

from torchvision import transforms

dataset = load_dataset("huggan/smithsonian_butterflies_subset", split="train")

# Ou charger des images à partir d'un dossier local

# dataset = load_dataset("imagefolder", data_dir="path/to/folder")

# Nous entraînerons sur des images carrées de 32 pixels, mais vous pouvez aussi essayer des tailles plus grandes

image_size = 32

# Vous pouvez réduire la taille de votre batch si vous manquez de mémoire GPU

batch_size = 64

# Définition les augmentations de données

preprocess = transforms.Compose(

[

transforms.Resize((image_size, image_size)), # Redimensionner

transforms.RandomHorizontalFlip(), # Retournement aléatoire

transforms.ToTensor(), # Convertir en tenseur (0, 1)

transforms.Normalize([0.5], [0.5]), # Passage en (-1, 1)

]

)

def transform(examples):

images = [preprocess(image.convert("RGB")) for image in examples["image"]]

return {"images": images}

dataset.set_transform(transform)

# Créer un chargeur de données à partir du jeu de données pour servir les images transformées en batchs

train_dataloader = torch.utils.data.DataLoader(

dataset, batch_size=batch_size, shuffle=True

)

Nous pouvons saisir un batch d’images et en visualiser quelques-unes comme suit :

xb = next(iter(train_dataloader))["images"].to(device)[:8]

print("X shape:", xb.shape)

show_images(xb).resize((8 * 64, 64), resample=Image.NEAREST)

Nous nous en tenons à un petit jeu de données avec des images de 32 pixels pour que les temps d’entraînement restent raisonnables dans ce notebook.

Définir le planificateur

Notre plan d’entraînement consiste à prendre ces images d’entrée et à leur ajouter du bruit, puis à transmettre les images bruitées au modèle. Lors de l’inférence, nous utiliserons les prédictions du modèle pour supprimer le bruit de manière itérative. Dans 🤗 Diffusers, ces deux processus sont gérés par le scheduler (planificateur).

Le planificateur de bruit détermine la quantité de bruit ajoutée à différents moments. Voici comment nous pourrions créer un planificateur en utilisant les paramètres par défaut pour l’entraînement et l’échantillonnage “DDPM” (d’après l’article d’après l’article Denoising Diffusion Probabalistic Models) :

from diffusers import DDPMScheduler

noise_scheduler = DDPMScheduler(num_train_timesteps=1000)

Le papier DDPM décrit un processus de corruption qui ajoute une petite quantité de bruit à chaque pas de temps. Étant donné $x_{t-1}$ pour un certain pas de temps, nous pouvons obtenir la version suivante (légèrement plus bruyante) $x_t$ avec :

\[\begin{aligned} q(\mathbf{x}_t \vert \mathbf{x}_{t-1}) &= \mathcal{N}(\mathbf{x}_t; \sqrt{1 - \beta_t} \mathbf{x}_{t-1}, \beta_t\mathbf{I}) \\ q(\mathbf{x}_{1:T} \vert \mathbf{x}_0) &= \prod^T_{t=1} q(\mathbf{x}_t \vert \mathbf{x}_{t-1}) \end{aligned}\]Nous prenons $x_{t-1}$, l’échelonnons de $\sqrt{1 - \beta_t}$ et ajoutons du bruit échelonné par $\beta_t$. Ce $\beta$ est défini pour chaque $t$ selon un certain planificateur et détermine la quantité de bruit ajoutée par pas de temps. Maintenant, nous ne voulons pas nécessairement faire cette opération 500 fois pour obtenir $x_{500}$, nous avons donc une autre formule pour obtenir $x_t$ pour n’importe quel t étant donné $x_0$ :

\[\begin{aligned} q(\mathbf{x}_t \vert \mathbf{x}_0) &= \mathcal{N}(\mathbf{x}_t; \sqrt{\bar{\alpha}_t} \mathbf{x}_0, {(1 - \bar{\alpha}_t)} \mathbf{I}) \end{aligned}\]où :

\[\bar{\alpha}_t = \prod_{i=1}^{T} \alpha_i,\quad \alpha_i = 1 - \beta_i\]La notation mathématique fait toujours peur ! Heureusement, le planificateur s’en charge pour nous. Nous pouvons tracer $\sqrt{\bar{\alpha}_t}$ (appelé sqrt_alpha_prod) et $\sqrt{(1 - \bar{\alpha}_t)}$ (appelé sqrt_one_minus_alpha_prod) pour voir comment l’entrée ($x$) et le bruit sont mis à l’échelle et mélangés à travers différents pas de temps :

plt.plot(noise_scheduler.alphas_cumprod.cpu() ** 0.5, label=r"${\sqrt{\bar{\alpha}_t}}$")

plt.plot((1 - noise_scheduler.alphas_cumprod.cpu()) ** 0.5, label=r"$\sqrt{(1 - \bar{\alpha}_t)}$")

plt.legend(fontsize="x-large");

✏️ À votre tour ! Vous pouvez explorer comment ce graphique change avec différents paramètres pour

beta_start,beta_endetbeta_scheduleen remplaçant l’une des options commentées ci-dessous :

## Exemple avec beaucoup de bruit ajouté :

# noise_scheduler = DDPMScheduler(num_train_timesteps=1000, beta_start=0.001, beta_end=0.004)

## Le planificateur cosinus pouvant s'avérer meilleur pour les images de petite taille :

# noise_scheduler = DDPMScheduler(num_train_timesteps=1000, beta_schedule='squaredcos_cap_v2')

Quel que soit le planificateur que vous avez choisi, nous pouvons maintenant l’utiliser pour ajouter du bruit en différentes quantités en utilisant la fonction noise_scheduler.add_noise comme suit :

timesteps = torch.linspace(0, 999, 8).long().to(device)

noise = torch.randn_like(xb)

noisy_xb = noise_scheduler.add_noise(xb, noise, timesteps)

print("Noisy X shape", noisy_xb.shape)

show_images(noisy_xb).resize((8 * 64, 64), resample=Image.NEAREST)

Là encore, étudiez l’effet de l’utilisation de différents planificateurs et paramètres de bruit. Cette vidéo (en anglais) explique en détail certains des calculs ci-dessus et constitue une excellente introduction à certains de ces concepts.

Définir le modèle

Nous en arrivons maintenant à l’élément central : le modèle lui-même.

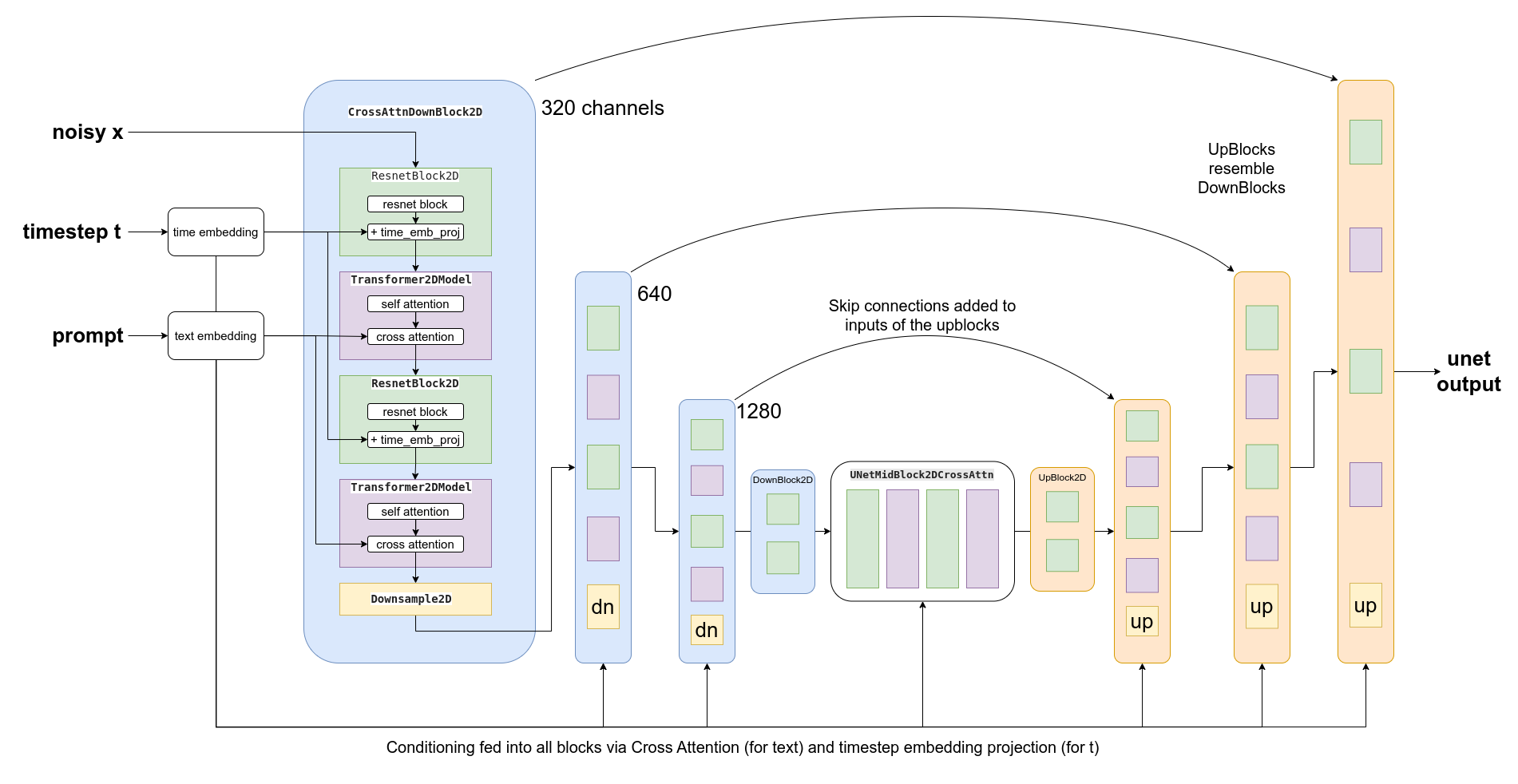

La plupart des modèles de diffusion utilisent des architectures qui sont des variantes d’un U-net et c’est ce que nous utiliserons ici.

En bref :

- l’image en entrée du modèle passe par plusieurs blocs de couches ResNet, chacun divisant la taille de l’image par 2

- puis elle passe à travers le même nombre de blocs qui la suréchantillonnent.

- il y a des skip connections qui relient les caractéristiques sur le chemin du sous-échantillonnage aux couches correspondantes dans le chemin du suréchantillonnage.

L’une des principales caractéristiques de ce modèle est qu’il prédit des images de la même taille que l’entrée, ce qui est exactement ce dont nous avons besoin ici.

🤗 Diffusers nous fournit une classe UNet2DModel pratique qui crée l’architecture désirée dans PyTorch.

Créons un U-net pour la taille d’image désirée. Notez que les down_block_types correspondent aux blocs de sous-échantillonnage (en vert sur le diagramme ci-dessus), et que les up_block_types sont les blocs de suréchantillonnage (en rouge sur le diagramme) :

from diffusers import UNet2DModel

# Création d'un modèle

model = UNet2DModel(

sample_size=image_size, # la résolution de l'image cible

in_channels=3, # le nombre de canaux d'entrée, 3 pour les images RVB

out_channels=3, # le nombre de canaux de sortie

layers_per_block=2, # le nombre de couches ResNet à utiliser par bloc UNet

block_out_channels=(64, 128, 128, 256), # Plus de canaux -> plus de paramètres

down_block_types=(

"DownBlock2D", # un bloc de sous-échantillonnage ResNet standard

"DownBlock2D",

"AttnDownBlock2D", # un bloc de sous-échantillonnage ResNet avec auto-attention spatiale

"AttnDownBlock2D",

),

up_block_types=(

"AttnUpBlock2D",

"AttnUpBlock2D", # un bloc de suréchantillonnage ResNet avec auto-attention spatiale

"UpBlock2D",

"UpBlock2D", # un bloc de suréchantillonnage ResNet standard

),

)

model.to(device)

Lorsque vous traitez des données d’entrée en haute résolution, vous pouvez utiliser davantage de blocs descendants et ascendants, et ne conserver les couches d’attention que pour les couches de résolution les plus basses (inférieures) afin de réduire l’utilisation de la mémoire. Nous verrons plus tard comment vous pouvez expérimenter pour trouver les meilleurs paramètres pour votre cas d’utilisation.

Nous pouvons vérifier que le passage d’un batch de données et de pas de temps aléatoires produit une sortie de même forme que les données d’entrée :

with torch.no_grad():

model_prediction = model(noisy_xb, timesteps).sample

model_prediction.shape

Dans la section suivante, nous verrons comment entraîner ce modèle.

Créer une boucle d’entraînement

Il est temps d’entraîner ! Voici une boucle d’optimisation typique dans PyTorch, où nous parcourons les données batch par batch et mettons à jour les paramètres de notre modèle à chaque étape à l’aide d’un optimiseur, ici, l’optimiseur AdamW avec un taux d’apprentissage de 0,0004.

Pour chaque batch de données, nous

- échantillonnons des pas de temps aléatoires

- bruitons les données en conséquence

- transmettons les données bruitées au modèle

- comparons les prédictions du modèle avec la cible (c’est-à-dire le bruit dans ce cas) en utilisant l’erreur quadratique moyenne comme fonction de perte

- mettons à jour les paramètres du modèle via

loss.backward()etoptimizer.step().

Au cours de ce processus, nous enregistrons aussi les pertes au fil du temps pour un tracé ultérieur.

NB : ce code prend près de 10 minutes à exécuter. N’hésitez pas à sauter ces deux cellules et à utiliser le modèle pré-entraîné si vous êtes pressé. Vous pouvez également étudier comment la réduction du nombre de canaux dans chaque couche via la définition du modèle ci-dessus peut accélérer les choses.

L’exemple officiel d’entraînement de 🤗 Diffusers entraîne un modèle plus grand sur ce jeu de données à une résolution plus élevée, et constitue une bonne référence pour ce à quoi ressemble une boucle d’entraînement moins minimale :

# Définir le planificateur de bruit

noise_scheduler = DDPMScheduler(

num_train_timesteps=1000, beta_schedule="squaredcos_cap_v2"

)

# Boucle d'entraînement

optimizer = torch.optim.AdamW(model.parameters(), lr=4e-4)

losses = []

for epoch in range(30):

for step, batch in enumerate(train_dataloader):

clean_images = batch["images"].to(device)

# Exemple de bruit à ajouter aux images

noise = torch.randn(clean_images.shape).to(clean_images.device)

bs = clean_images.shape[0]

# Échantillonner un pas de temps aléatoire pour chaque image

timesteps = torch.randint(

0, noise_scheduler.num_train_timesteps, (bs,), device=clean_images.device

).long()

# Ajouter du bruit aux images propres en fonction de l'ampleur du bruit à chaque étape

noisy_images = noise_scheduler.add_noise(clean_images, noise, timesteps)

# Obtenir la prédiction du modèle

noise_pred = model(noisy_images, timesteps, return_dict=False)[0]

# Calculer la perte

loss = F.mse_loss(noise_pred, noise)

loss.backward(loss)

losses.append(loss.item())

# Mise à jour des paramètres du modèle à l'aide de l'optimiseur

optimizer.step()

optimizer.zero_grad()

if (epoch + 1) % 5 == 0:

loss_last_epoch = sum(losses[-len(train_dataloader) :]) / len(train_dataloader)

print(f"Epoch:{epoch+1}, loss: {loss_last_epoch}")

En traçant la perte, nous constatons que le modèle s’améliore rapidement dans un premier temps, puis continue à s’améliorer à un rythme plus lent (ce qui est plus évident si nous utilisons une échelle logarithmique, comme indiqué à droite) :

fig, axs = plt.subplots(1, 2, figsize=(12, 4))

axs[0].plot(losses)

axs[1].plot(np.log(losses))

plt.show()

Au lieu d’exécuter le code d’entraînement ci-dessus, vous pouvez utiliser le modèle du pipeline comme suit :

## Décommenter pour charger le modèle que j'ai entraîné plus tôt à la place :

# model = butterfly_pipeline.unet

Générer des images

Comment obtenir des images avec ce modèle ?

• Option 1 : Création d’un pipeline :

from diffusers import DDPMPipeline

image_pipe = DDPMPipeline(unet=model, scheduler=noise_scheduler)

pipeline_output = image_pipe()

pipeline_output.images[0]

Nous pouvons enregistrer un pipeline dans un dossier local comme suit :

image_pipe.save_pretrained("my_pipeline")

Inspection du contenu du dossier :

!ls my_pipeline/

model_index.json scheduler unet

Les sous-dossiers scheduler et unet contiennent tout ce qui est nécessaire pour recréer ces composants. Par exemple, dans le dossier unet vous trouverez les poids du modèle (diffusion_pytorch_model.bin) ainsi qu’un fichier de configuration qui spécifie l’architecture UNet.

!ls my_pipeline/unet/

config.json diffusion_pytorch_model.bin

Ensemble, ces fichiers contiennent tout ce qui est nécessaire pour recréer le pipeline. Vous pouvez les télécharger manuellement sur le Hub pour partager le pipeline avec d’autres personnes, ou consulter le code pour le faire via l’API dans la section suivante.

• Option 2 : écrire une boucle d’échantillonnage

Si vous inspectez la méthode forward du pipeline, vous pourrez voir ce qui se passe lorsque nous lançons image_pipe() :

# ??image_pipe.forward

Nous commençons par un bruit aléatoire et parcourons les pas de temps de l’ordonnanceur du plus bruyant au moins bruyant, en supprimant une petite quantité de bruit à chaque étape sur la base de la prédiction du modèle :

# Point de départ aléatoire (8 images aléatoires) :

sample = torch.randn(8, 3, 32, 32).to(device)

for i, t in enumerate(noise_scheduler.timesteps):

# Obtenir le modèle de prédiction

with torch.no_grad():

residual = model(sample, t).sample

# Mise à jour de l'échantillon avec le pas

sample = noise_scheduler.step(residual, t, sample).prev_sample

show_images(sample)

La fonction noise_scheduler.step() effectue les calculs nécessaires pour mettre à jour sample de manière appropriée. Il existe un certain nombre de méthodes d’échantillonnage. Dans l’unité suivante, nous verrons comment nous pouvons échanger un échantillonneur différent pour accélérer la génération d’images avec des modèles existants, et nous parlerons plus en détail de la théorie derrière l’échantillonnage des modèles de diffusion.

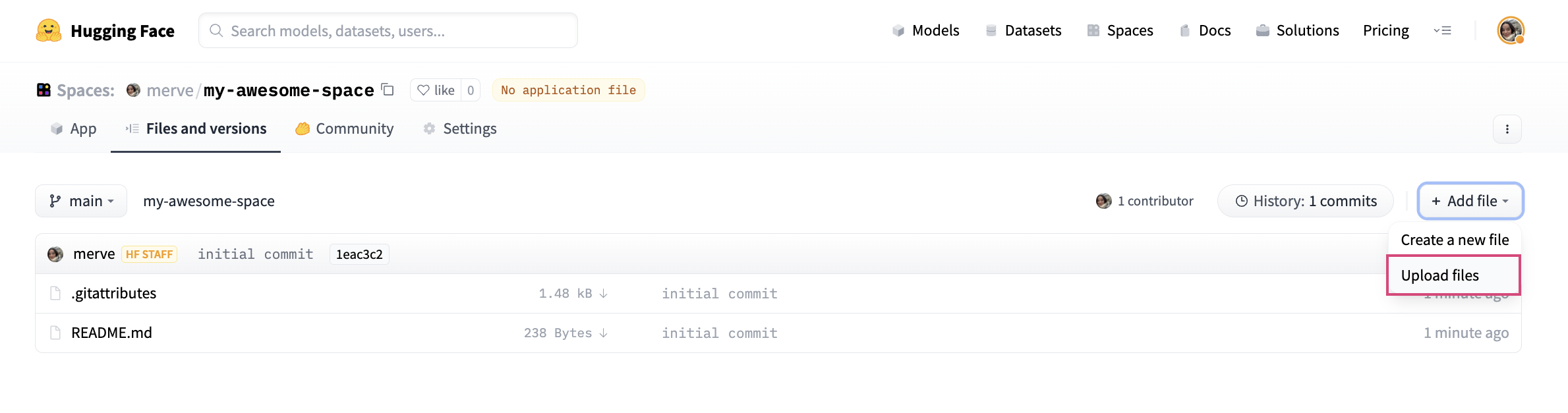

Pousser votre modèle vers le Hub

Dans l’exemple ci-dessus, nous avons enregistré notre pipeline dans un dossier local. Pour pousser notre modèle vers le Hub, nous aurons besoin d’un dépôt de modèles dans lequel nous pourrons pousser nos fichiers. Nous déterminerons le nom du dépôt à partir de l’ID du modèle que nous voulons donner à notre modèle (n’hésitez pas à remplacer le nom du modèle par votre propre choix ; il doit juste contenir votre nom d’utilisateur, ce que fait la fonction get_full_repo_name()) :

from huggingface_hub import get_full_repo_name

model_name = "sd-class-butterflies-32"

hub_model_id = get_full_repo_name(model_name)

hub_model_id

Ensuite, créer un dépôt de modèle sur le 🤗 Hub et pousser notre modèle :

from huggingface_hub import HfApi, create_repo

create_repo(hub_model_id)

api = HfApi()

api.upload_folder(

folder_path="my_pipeline/scheduler", path_in_repo="", repo_id=hub_model_id

)

api.upload_folder(folder_path="my_pipeline/unet", path_in_repo="", repo_id=hub_model_id)

api.upload_file(

path_or_fileobj="my_pipeline/model_index.json",

path_in_repo="model_index.json",

repo_id=hub_model_id,

)

La dernière chose à faire est de créer une belle carte modèle afin que notre générateur de papillons puisse être facilement trouvé sur le 🤗 Hub (n’hésitez pas à développer et à modifier la description !) :

from huggingface_hub import ModelCard

content = f"""

---

license: mit

tags:

- pytorch

- diffusers

- unconditional-image-generation

- diffusion-models-class

---

# Model Card for Unit 1 of the [Diffusion Models Class 🧨](https://github.com/huggingface/diffusion-models-class)

This model is a diffusion model for unconditional image generation of cute 🦋.

## Usage

```python

from diffusers import DDPMPipeline

pipeline = DDPMPipeline.from_pretrained('{hub_model_id}')

image = pipeline().images[0]

image

```python

"""

card = ModelCard(content)

card.push_to_hub(hub_model_id)

Maintenant que le modèle est sur le Hub, vous pouvez le télécharger de n’importe où en utilisant la méthode from_pretrained() de DDPMPipeline comme suit :

from diffusers import DDPMPipeline

image_pipe = DDPMPipeline.from_pretrained(hub_model_id)

pipeline_output = image_pipe()

pipeline_output.images[0]

Bien, ça marche !

Passer à l’échelle supérieure avec 🤗 Accelerate

Ce notebook a été conçu à des fins d’apprentissage, et en tant que tel, nous avons essayé de garder le code aussi minimal et propre que possible. Pour cette raison, nous avons omis certaines choses que vous pourriez souhaiter si vous deviez entraîner un modèle plus grand sur beaucoup plus de données, comme le support multi-GPU, la trace de la progression et des images d’exemple, la sauvegarde du gradient pour supporter des tailles de batch plus importantes, le téléchargement automatique des modèles et ainsi de suite. Heureusement, la plupart de ces fonctionnalités sont disponibles dans l’exemple de script d’entraînement ici..

Vous pouvez télécharger le fichier comme suit :

!wget https://github.com/huggingface/diffusers/raw/main/examples/unconditional_image_generation/train_unconditional.py

Ouvrez le fichier et vous verrez où le modèle est défini et quels sont les paramètres disponibles. Nous exécutons le script à l’aide de la commande suivante :

# Donnons un nom à notre nouveau modèle pour le Hub

model_name = "sd-class-butterflies-64"

hub_model_id = get_full_repo_name(model_name)

!accelerate launch train_unconditional.py \

--dataset_name="huggan/smithsonian_butterflies_subset" \

--resolution=64 \

--output_dir={model_name} \

--train_batch_size=32 \

--num_epochs=50 \

--gradient_accumulation_steps=1 \

--learning_rate=1e-4 \

--lr_warmup_steps=500 \

--mixed_precision="no"

Comme précédemment, poussons le modèle vers le Hub et créons une belle carte de modèle (et n’hésitez pas à l’éditer comme vous le souhaitez !):

create_repo(hub_model_id)

api = HfApi()

api.upload_folder(

folder_path=f"{model_name}/scheduler", path_in_repo="", repo_id=hub_model_id

)

api.upload_folder(

folder_path=f"{model_name}/unet", path_in_repo="", repo_id=hub_model_id

)

api.upload_file(

path_or_fileobj=f"{model_name}/model_index.json",

path_in_repo="model_index.json",

repo_id=hub_model_id,

)

content = f"""

---

license: mit

tags:

- pytorch

- diffusers

- unconditional-image-generation

- diffusion-models-class

---

# Model Card for Unit 1 of the [Diffusion Models Class 🧨](https://github.com/huggingface/diffusion-models-class)

This model is a diffusion model for unconditional image generation of cute 🦋.

## Usage

```python

from diffusers import DDPMPipeline

pipeline = DDPMPipeline.from_pretrained('{hub_model_id}')

image = pipeline().images[0]

image

```python

"""

card = ModelCard(content)

card.push_to_hub(hub_model_id)

Environ 45 minutes plus tard, voici le résultat :

pipeline = DDPMPipeline.from_pretrained(hub_model_id).to(device)

images = pipeline(batch_size=8).images

make_grid(images)

✏️ À votre tour ! Essayez de trouver des paramètres d’entraînement/de modèle qui donnent de bons résultats en un minimum de temps, et partagez vos résultats avec la communauté. Fouillez dans le script pour voir si vous pouvez comprendre le code, et demandez des éclaircissements sur tout ce qui vous semble confus.

Pistes pour approndonfir

Nous espérons vous avoir donné un avant-goût de ce que vous pouvez faire avec la bibliothèque 🤗 Diffusers ! Voici quelques pistes possibles pour la suite :

- Essayez d’entraîner un modèle de diffusion inconditionnel sur un nouveau jeu de données. Points bonus si vous en créez un vous-même. Vous pouvez trouver d’excellents jeux de données d’images pour cette tâche dans l’organisation HugGan sur le Hub. Assurez-vous simplement de les sous-échantillonner si vous ne voulez pas attendre très longtemps pour que le modèle s’entraîne !

- Essayez DreamBooth pour créer votre propre pipeline de Stable Diffusion personnalisé en utilisant ce Space ou ce notebook.

- Modifiez le script d’entraînement pour explorer différents hyperparamètres UNet (nombre de couches, canaux, etc.), différents schémas de bruit, etc.

- Consultez le notebook Implémentation à partir de 0 pour une approche différente des idées fondamentales que nous avons abordées dans cette unité.

1.2. Implémentation à partir de 0

Il est parfois utile de considérer la version la plus simple possible d’une chose pour mieux en comprendre le fonctionnement. C’est ce que nous allons essayer de faire dans ce notebook, en commençant par un modèle de diffusion jouet pour voir comment les différents éléments fonctionnent, puis en examinant en quoi ils diffèrent d’une mise en œuvre plus complexe.

Nous examinerons :

- Le processus de corruption (ajouter du bruit aux données)

- Ce qu’est un UNet, et comment en implémenter un extrêmement minimal à partir de zéro

- L’entraînement au modèle de diffusion

- La théorie de l’échantillonnage

Ensuite, nous comparerons nos versions avec l’implémentation DDPM des diffuseurs, en explorant :

- Les améliorations par rapport à notre mini UNet

- Le schéma de bruit du DDPM

- Les différences dans l’objectif d’entraînement

- Le conditionnement du pas de temps

- Les approches d’échantillonnage

Ce notebook est assez approfondi, et peut être sauté en toute sécurité si vous n’êtes pas enthousiaste à l’idée d’une plongée en profondeur à partir de zéro !

Il convient également de noter que la plupart du code ici est utilisé à des fins d’illustration, et nous ne recommandons pas de l’adopter directement pour votre propre travail (à moins que vous n’essayiez d’améliorer les exemples montrés ici à des fins d’apprentissage).

Configuration et importations

!pip install -q diffusers

import torch

import torchvision

from torch import nn

from torch.nn import functional as F

from torch.utils.data import DataLoader

from diffusers import DDPMScheduler, UNet2DModel

from matplotlib import pyplot as plt

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

print(f'Using device: {device}')

Les données

Nous allons tester les choses avec un très petit jeu de données : MNIST. Si vous souhaitez donner au modèle un défi un peu plus difficile à relever sans rien changer d’autre, torchvision.datasets.FashionMNIST devrait faire l’affaire.

dataset = torchvision.datasets.MNIST(root="mnist/", train=True, download=True, transform=torchvision.transforms.ToTensor())

train_dataloader = DataLoader(dataset, batch_size=8, shuffle=True)

x, y = next(iter(train_dataloader))

print('Input shape:', x.shape)

print('Labels:', y)

plt.imshow(torchvision.utils.make_grid(x)[0], cmap='Greys')

Input shape: torch.Size([8, 1, 28, 28])

Labels: tensor([1, 9, 7, 3, 5, 2, 1, 4])

Chaque image est un dessin en niveaux de gris de 28 par 28 pixels d’un chiffre, avec des valeurs allant de 0 à 1.

Le processus de corruption

Supposons que vous n’ayez lu aucun papier sur les modèles de diffusion, mais que vous sachiez que le processus implique l’ajout de bruit. Comment feriez-vous ?

Nous souhaitons probablement disposer d’un moyen simple de contrôler le degré de corruption. Et si nous prenions un paramètre pour la quantité de bruit à ajouter, et que nous le faisions :

noise = torch.rand_like(x)

noisy_x = (1-amount)*x + amount*noise

Si amount = 0, nous récupérons l’entrée sans aucun changement. Si le montant atteint $1$, nous récupérons du bruit sans aucune trace de l’entrée $x$. En mélangeant l’entrée avec du bruit de cette façon, nous gardons la sortie dans la même plage ($0$ à $1$).

Nous pouvons mettre cela en œuvre assez facilement (il suffit de surveiller les formes pour ne pas se faire piéger par les règles de diffusion) :

def corrupt(x, amount):

"""Corrompre l'entrée `x` en la mélangeant avec du bruit selon `amount`"""

noise = torch.rand_like(x)

amount = amount.view(-1, 1, 1, 1) # Trier les formes pour que la transmission fonctionne

return x*(1-amount) + noise*amount

Et regarder les résultats visuellement pour voir que cela fonctionne comme prévu :

# Tracer les données d'entrée

fig, axs = plt.subplots(2, 1, figsize=(12, 5))

axs[0].set_title('Input data')

axs[0].imshow(torchvision.utils.make_grid(x)[0], cmap='Greys')

# Ajouter du bruit

amount = torch.linspace(0, 1, x.shape[0]) # De gauche à droite -> plus de corruption

noised_x = corrupt(x, amount)

# Tracé de la version bruitée

axs[1].set_title('Corrupted data (-- amount increases -->)')

axs[1].imshow(torchvision.utils.make_grid(noised_x)[0], cmap='Greys')

Lorsque la quantité de bruit s’approche de 1, nos données commencent à ressembler à du bruit aléatoire pur. Mais pour la plupart des noise_amounts, vous pouvez deviner le chiffre assez bien. Pensez-vous que cela soit optimal ?

Le modèle

Nous aimerions un modèle qui prenne en compte des images bruitées de 28px et qui produise une prédiction de la même forme. Un choix populaire ici est une architecture appelée UNet. Inventé à l’origine pour les tâches de segmentation en imagerie médicale, un UNet se compose d’un “chemin de compression” par lequel les données sont comprimées et d’un “chemin d’expansion” par lequel elles s’étendent à nouveau jusqu’à la dimension d’origine (similaire à un autoencodeur), mais il comporte également des connexions de saut qui permettent aux informations et aux gradients de circuler à différents niveaux.

Certains UNets comportent des blocs complexes à chaque étape, mais pour cette petite démonstration, nous construirons un exemple minimal qui prend une image à un canal et la fait passer par trois couches convolutives sur le chemin descendant (les down_layers dans le diagramme et le code) et trois sur le chemin ascendant, avec des sauts de connexion entre les couches descendantes et ascendantes. Nous utiliserons max pooling pour le downsampling et nn.Upsample pour le upsampling plutôt que de nous appuyer sur des couches apprenantes comme les UNets plus complexes. Voici l’architecture approximative montrant le nombre de canaux dans la sortie de chaque couche :

Voici à quoi cela ressemble dans le code :

class BasicUNet(nn.Module):

"""Une mise en œuvre minimale du UNet"""

def __init__(self, in_channels=1, out_channels=1):

super().__init__()

self.down_layers = torch.nn.ModuleList([

nn.Conv2d(in_channels, 32, kernel_size=5, padding=2),

nn.Conv2d(32, 64, kernel_size=5, padding=2),

nn.Conv2d(64, 64, kernel_size=5, padding=2),

])

self.up_layers = torch.nn.ModuleList([

nn.Conv2d(64, 64, kernel_size=5, padding=2),

nn.Conv2d(64, 32, kernel_size=5, padding=2),

nn.Conv2d(32, out_channels, kernel_size=5, padding=2),

])

self.act = nn.SiLU() # La fonction d'activation

self.downscale = nn.MaxPool2d(2)

self.upscale = nn.Upsample(scale_factor=2)

def forward(self, x):

h = []

for i, l in enumerate(self.down_layers):

x = self.act(l(x)) # À travers la couche et la fonction d'activation

if i < 2: # Pour toutes les couches sauf la troisième (dernière) :

h.append(x) # Stockage de la sortie pour la skip connexion

x = self.downscale(x) # Réduction d'échelle pour la couche suivante

for i, l in enumerate(self.up_layers):

if i > 0:

x = self.upscale(x) # Upscale

x += h.pop() # Récupération d'un résultat stocké (skip connection)

x = self.act(l(x)) # Par le biais de la couche et de la fonction d'activation

return x

Nous pouvons vérifier que la forme de la sortie est la même que celle de l’entrée, comme nous nous y attendions :

net = BasicUNet()

x = torch.rand(8, 1, 28, 28)

net(x).shape

torch.Size([8, 1, 28, 28])

Ce réseau compte un peu plus de 300 000 paramètres :

sum([p.numel() for p in net.parameters()])

309057

Vous pouvez envisager de modifier le nombre de canaux dans chaque couche ou d’intervertir les architectures si vous le souhaitez.

Entraîner le réseau

Que doit faire exactement le modèle ? Là encore, il y a plusieurs façons de procéder, mais pour cette démonstration, choisissons un cadre simple : étant donné une entrée corrompue noisy_x, le modèle doit produire sa meilleure estimation de ce à quoi ressemble l’original $x$. Nous comparerons cette valeur à la valeur réelle par le biais de l’erreur quadratique moyenne. Nous comparerons cette estimation à la valeur réelle par le biais de l’erreur quadratique moyenne.

Nous pouvons maintenant entraîner le réseau.

- Obtenir un batch de données

- Corrompre les données de manière aléatoire

- Nourrir le modèle avec ces données

- Comparer les prédictions du modèle avec les images propres pour calculer notre perte

- Mettre à jour les paramètres du modèle en conséquence.

N’hésitez pas à modifier ce modèle et à voir si vous pouvez l’améliorer !

# Chargeur de données (vous pouvez modifier la taille des batchs)

batch_size = 128

train_dataloader = DataLoader(dataset, batch_size=batch_size, shuffle=True)

# Combien de fois devrions-nous passer les données en revue ?

n_epochs = 3

# Créer le réseau

net = BasicUNet()

net.to(device)

# Notre fonction de perte

loss_fn = nn.MSELoss()

# L'optimiseur

opt = torch.optim.Adam(net.parameters(), lr=1e-3)

# Conserver une trace des pertes pour les consulter ultérieurement

losses = []

# La boucle d'entraînement

for epoch in range(n_epochs):

for x, y in train_dataloader:

# Obtenir des données et préparer la version corrompue

x = x.to(device) # Data on the GPU

noise_amount = torch.rand(x.shape[0]).to(device) # Pick random noise amounts

noisy_x = corrupt(x, noise_amount) # Create our noisy x

# Obtenir la prédiction du modèle

pred = net(noisy_x)

# Calculer la perte

loss = loss_fn(pred, x) # Dans quelle mesure la sortie est-elle proche du véritable x "propre" ?

# Rétropropager et mettre à jour les paramètres

opt.zero_grad()

loss.backward()

opt.step()

# Stocker la perte pour plus tard

losses.append(loss.item())

# Afficher la moyenne des valeurs de perte pour cette époque :

avg_loss = sum(losses[-len(train_dataloader):])/len(train_dataloader)

print(f'Finished epoch {epoch}. Average loss for this epoch: {avg_loss:05f}')

# Visualiser la courbe des pertes

plt.plot(losses)

plt.ylim(0, 0.1)

Finished epoch 0. Average loss for this epoch: 0.026736

Finished epoch 1. Average loss for this epoch: 0.020692

Finished epoch 2. Average loss for this epoch: 0.018887

Nous pouvons essayer de voir à quoi ressemblent les prédictions du modèle en saisissant un batch de données, en les corrompant à différents degrés et en visualisant ensuite les prédictions du modèle :

# Récupérer des données

x, y = next(iter(train_dataloader))

x = x[:8] # Seuls les 8 premiers sont utilisés pour faciliter le graphique

# Corruption avec une échelle de montants

amount = torch.linspace(0, 1, x.shape[0]) # De gauche à droite -> plus de corruption

noised_x = corrupt(x, amount)

# Obtenir les prédictions du modèle

with torch.no_grad():

preds = net(noised_x.to(device)).detach().cpu()

# Graphique

fig, axs = plt.subplots(3, 1, figsize=(12, 7))

axs[0].set_title('Input data')

axs[0].imshow(torchvision.utils.make_grid(x)[0].clip(0, 1), cmap='Greys')

axs[1].set_title('Corrupted data')

axs[1].imshow(torchvision.utils.make_grid(noised_x)[0].clip(0, 1), cmap='Greys')

axs[2].set_title('Network Predictions')

axs[2].imshow(torchvision.utils.make_grid(preds)[0].clip(0, 1), cmap='Greys

Vous pouvez constater que pour les montants les plus faibles, les prédictions sont plutôt bonnes ! Mais lorsque le niveau devient très élevé, le modèle a moins d’éléments pour travailler, et lorsque nous arrivons à amount=1, il produit un désordre flou proche de la moyenne du jeu de données pour essayer de couvrir ses paris sur ce à quoi la sortie pourrait ressembler…

Échantillonnage

Si nos prédictions à des niveaux de bruit élevés ne sont pas très bonnes, comment générer des images ?

Et si nous partions d’un bruit aléatoire, que nous regardions les prédictions du modèle, mais que nous ne nous rapprochions que très peu de cette prédiction (disons, 20 % du chemin). Nous disposons alors d’une image très bruyante dans laquelle il y a peut-être un soupçon de structure, que nous pouvons introduire dans le modèle pour obtenir une nouvelle prédiction. Nous espérons que cette nouvelle prédiction est légèrement meilleure que la première (puisque notre point de départ est légèrement moins bruité) et que nous pouvons donc faire un autre petit pas avec cette nouvelle et meilleure prédiction.

Nous répétons l’opération plusieurs fois et (si tout se passe bien) nous obtenons une image ! Voici ce processus illustré en seulement 5 étapes, en visualisant l’entrée du modèle (à gauche) et les images débruitées prédites (à droite) à chaque étape. Notez que même si le modèle prédit l’image débruitée dès l’étape 1, nous ne faisons qu’une partie du chemin. Au fil des étapes, les structures apparaissent et sont affinées, jusqu’à ce que nous obtenions nos résultats finaux.

n_steps = 5

x = torch.rand(8, 1, 28, 28).to(device) # Commencer au hasard

step_history = [x.detach().cpu()]

pred_output_history = []

for i in range(n_steps):

with torch.no_grad(): # Pas besoin de suivre les gradients pendant l'inférence

pred = net(x) # Prédire le x0 débruité

pred_output_history.append(pred.detach().cpu()) # Stocker les résultats du modèle pour les tracer

mix_factor = 1/(n_steps - i) # Dans quelle mesure nous nous rapprochons de la prédiction

x = x*(1-mix_factor) + pred*mix_factor # Déplacer une partie du chemin

step_history.append(x.detach().cpu()) # Stocker l'étape pour le graphique

fig, axs = plt.subplots(n_steps, 2, figsize=(9, 4), sharex=True)

axs[0,0].set_title('x (model input)')

axs[0,1].set_title('model prediction')

for i in range(n_steps):

axs[i, 0].imshow(torchvision.utils.make_grid(step_history[i])[0].clip(0, 1), cmap='Greys')

axs[i, 1].imshow(torchvision.utils.make_grid(pred_output_history[i])[0].clip(0, 1), cmap='Greys')

Nous pouvons diviser le processus en plusieurs étapes et espérer ainsi obtenir de meilleures images :

n_steps = 40

x = torch.rand(64, 1, 28, 28).to(device)

for i in range(n_steps):

noise_amount = torch.ones((x.shape[0], )).to(device) * (1-(i/n_steps)) # Starting high going low

with torch.no_grad():

pred = net(x)

mix_factor = 1/(n_steps - i)

x = x*(1-mix_factor) + pred*mix_factor

fig, ax = plt.subplots(1, 1, figsize=(12, 12))

ax.imshow(torchvision.utils.make_grid(x.detach().cpu(), nrow=8)[0].clip(0, 1), cmap='Greys')

Ce n’est pas génial, mais il y a des chiffres reconnaissables ! Vous pouvez expérimenter en entraînant plus longtemps (disons, 10 ou 20 époques) et en modifiant la configuration du modèle, le taux d’apprentissage, l’optimiseur, etc. N’oubliez pas non plus que fashionMNIST peut être remplacé en une ligne si vous voulez essayer un jeu de données un peu plus difficile.

Comparaison avec DDPM

Dans cette section, nous allons voir comment notre implémentation diffère de l’approche utilisée dans l’autre notebook (Introduction à Diffusers), qui est basé sur l’article de DDPM.

Nous verrons que

- Le diffuseur

UNet2DModelest un peu plus avancé que notre BasicUNet - Le processus de corruption est traité différemment

- L’objectif d’entraînement est différent, puisqu’il s’agit de prédire le bruit plutôt que l’image débruitée.

- Le modèle est conditionné sur la quantité de bruit présent via un conditionnement par pas de temps, où t est transmis comme un argument supplémentaire à la méthode forward.

- Il existe un certain nombre de stratégies d’échantillonnage différentes, qui devraient fonctionner mieux que notre version simpliste ci-dessus.

Un certain nombre d’améliorations ont été suggérées depuis la publication de l’article sur le DDPM, mais nous espérons que cet exemple est instructif en ce qui concerne les différentes décisions de conception possibles. Une fois que vous aurez lu cet article, vous pourrez vous plonger dans le document intitulé Elucidating the Design Space of Diffusion-Based Generative Models qui examine tous ces composants en détail et formule de nouvelles recommandations sur la manière d’obtenir les meilleures performances.

Si tout cela est trop technique ou intimidant, ne vous inquiétez pas ! N’hésitez pas à sauter le reste de ce notebook ou à le garder pour un jour de pluie.

L’UNet

Le modèle UNet2DModel de 🤗 Diffusers comporte un certain nombre d’améliorations par rapport à notre UNet de base ci-dessus :

- GroupNorm applique une normalisation par groupe aux entrées de chaque bloc

- Couches de dropout pour un entraînement plus doux

- Plusieurs couches de ResNet par bloc (si layers_per_block n’est pas fixé à 1)

- Attention (généralement utilisé uniquement pour les blocs à faible résolution)

- Conditionnement sur le pas de temps

- Blocs de sous-échantillonnage et de suréchantillonnage avec des paramètres pouvant être appris

Créons et inspectons un modèle UNet2DModel :

model = UNet2DModel(

sample_size=28, # la résolution de l'image cible

in_channels=1, # le nombre de canaux d'entrée, 3 pour les images RVB

out_channels=1, # le nombre de canaux de sortie

layers_per_block=2, # le nombre de couches ResNet à utiliser par bloc UNet

block_out_channels=(32, 64, 64), # Correspondant à peu près à notre exemple UNet de base

down_block_types=(

"DownBlock2D", # un bloc de sous-échantillonnage ResNet normal

"AttnDownBlock2D", # un bloc de sous-échantillonnage ResNet avec auto-attention spatiale

"AttnDownBlock2D",

),

up_block_types=(

"AttnUpBlock2D",

"AttnUpBlock2D", # un bloc de suréchantillonnage ResNet avec auto-attention spatiale

"UpBlock2D", # un bloc de suréchantillonnage ResNet standard

),

)

print(model)

Afficher / masquer la sortie de print(model)

UNet2DModel(

(conv_in): Conv2d(1, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_proj): Timesteps()

(time_embedding): TimestepEmbedding(

(linear_1): Linear(in_features=32, out_features=128, bias=True)

(act): SiLU()

(linear_2): Linear(in_features=128, out_features=128, bias=True)

)

(down_blocks): ModuleList(

(0): DownBlock2D(

(resnets): ModuleList(

(0): ResnetBlock2D(

(norm1): GroupNorm(32, 32, eps=1e-05, affine=True)

(conv1): Conv2d(32, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=32, bias=True)

(norm2): GroupNorm(32, 32, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(32, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

)

(1): ResnetBlock2D(

(norm1): GroupNorm(32, 32, eps=1e-05, affine=True)

(conv1): Conv2d(32, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=32, bias=True)

(norm2): GroupNorm(32, 32, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(32, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

)

)

(downsamplers): ModuleList(

(0): Downsample2D(

(conv): Conv2d(32, 32, kernel_size=(3, 3), stride=(2, 2), padding=(1, 1))

)

)

)

(1): AttnDownBlock2D(

(attentions): ModuleList(

(0): AttentionBlock(

(group_norm): GroupNorm(32, 64, eps=1e-05, affine=True)

(query): Linear(in_features=64, out_features=64, bias=True)

(key): Linear(in_features=64, out_features=64, bias=True)

(value): Linear(in_features=64, out_features=64, bias=True)

(proj_attn): Linear(in_features=64, out_features=64, bias=True)

)

(1): AttentionBlock(

(group_norm): GroupNorm(32, 64, eps=1e-05, affine=True)

(query): Linear(in_features=64, out_features=64, bias=True)

(key): Linear(in_features=64, out_features=64, bias=True)

(value): Linear(in_features=64, out_features=64, bias=True)

(proj_attn): Linear(in_features=64, out_features=64, bias=True)

)

)

(resnets): ModuleList(

(0): ResnetBlock2D(

(norm1): GroupNorm(32, 32, eps=1e-05, affine=True)

(conv1): Conv2d(32, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

(conv_shortcut): Conv2d(32, 64, kernel_size=(1, 1), stride=(1, 1))

)

(1): ResnetBlock2D(

(norm1): GroupNorm(32, 64, eps=1e-05, affine=True)

(conv1): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

)

)

(downsamplers): ModuleList(

(0): Downsample2D(

(conv): Conv2d(64, 64, kernel_size=(3, 3), stride=(2, 2), padding=(1, 1))

)

)

)

(2): AttnDownBlock2D(

(attentions): ModuleList(

(0): AttentionBlock(

(group_norm): GroupNorm(32, 64, eps=1e-05, affine=True)

(query): Linear(in_features=64, out_features=64, bias=True)

(key): Linear(in_features=64, out_features=64, bias=True)

(value): Linear(in_features=64, out_features=64, bias=True)

(proj_attn): Linear(in_features=64, out_features=64, bias=True)

)

(1): AttentionBlock(

(group_norm): GroupNorm(32, 64, eps=1e-05, affine=True)

(query): Linear(in_features=64, out_features=64, bias=True)

(key): Linear(in_features=64, out_features=64, bias=True)

(value): Linear(in_features=64, out_features=64, bias=True)

(proj_attn): Linear(in_features=64, out_features=64, bias=True)

)

)

(resnets): ModuleList(

(0): ResnetBlock2D(

(norm1): GroupNorm(32, 64, eps=1e-05, affine=True)

(conv1): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

)

(1): ResnetBlock2D(

(norm1): GroupNorm(32, 64, eps=1e-05, affine=True)

(conv1): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

)

)

)

)

(up_blocks): ModuleList(

(0): AttnUpBlock2D(

(attentions): ModuleList(

(0): AttentionBlock(

(group_norm): GroupNorm(32, 64, eps=1e-05, affine=True)

(query): Linear(in_features=64, out_features=64, bias=True)

(key): Linear(in_features=64, out_features=64, bias=True)

(value): Linear(in_features=64, out_features=64, bias=True)

(proj_attn): Linear(in_features=64, out_features=64, bias=True)

)

(1): AttentionBlock(

(group_norm): GroupNorm(32, 64, eps=1e-05, affine=True)

(query): Linear(in_features=64, out_features=64, bias=True)

(key): Linear(in_features=64, out_features=64, bias=True)

(value): Linear(in_features=64, out_features=64, bias=True)

(proj_attn): Linear(in_features=64, out_features=64, bias=True)

)

(2): AttentionBlock(

(group_norm): GroupNorm(32, 64, eps=1e-05, affine=True)

(query): Linear(in_features=64, out_features=64, bias=True)

(key): Linear(in_features=64, out_features=64, bias=True)

(value): Linear(in_features=64, out_features=64, bias=True)

(proj_attn): Linear(in_features=64, out_features=64, bias=True)

)

)

(resnets): ModuleList(

(0): ResnetBlock2D(

(norm1): GroupNorm(32, 128, eps=1e-05, affine=True)

(conv1): Conv2d(128, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

(conv_shortcut): Conv2d(128, 64, kernel_size=(1, 1), stride=(1, 1))

)

(1): ResnetBlock2D(

(norm1): GroupNorm(32, 128, eps=1e-05, affine=True)

(conv1): Conv2d(128, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

(conv_shortcut): Conv2d(128, 64, kernel_size=(1, 1), stride=(1, 1))

)

(2): ResnetBlock2D(

(norm1): GroupNorm(32, 128, eps=1e-05, affine=True)

(conv1): Conv2d(128, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

(conv_shortcut): Conv2d(128, 64, kernel_size=(1, 1), stride=(1, 1))

)

)

(upsamplers): ModuleList(

(0): Upsample2D(

(conv): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

)

)

)

(1): AttnUpBlock2D(

(attentions): ModuleList(

(0): AttentionBlock(

(group_norm): GroupNorm(32, 64, eps=1e-05, affine=True)

(query): Linear(in_features=64, out_features=64, bias=True)

(key): Linear(in_features=64, out_features=64, bias=True)

(value): Linear(in_features=64, out_features=64, bias=True)

(proj_attn): Linear(in_features=64, out_features=64, bias=True)

)

(1): AttentionBlock(

(group_norm): GroupNorm(32, 64, eps=1e-05, affine=True)

(query): Linear(in_features=64, out_features=64, bias=True)

(key): Linear(in_features=64, out_features=64, bias=True)

(value): Linear(in_features=64, out_features=64, bias=True)

(proj_attn): Linear(in_features=64, out_features=64, bias=True)

)

(2): AttentionBlock(

(group_norm): GroupNorm(32, 64, eps=1e-05, affine=True)

(query): Linear(in_features=64, out_features=64, bias=True)

(key): Linear(in_features=64, out_features=64, bias=True)

(value): Linear(in_features=64, out_features=64, bias=True)

(proj_attn): Linear(in_features=64, out_features=64, bias=True)

)

)

(resnets): ModuleList(

(0): ResnetBlock2D(

(norm1): GroupNorm(32, 128, eps=1e-05, affine=True)

(conv1): Conv2d(128, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

(conv_shortcut): Conv2d(128, 64, kernel_size=(1, 1), stride=(1, 1))

)

(1): ResnetBlock2D(

(norm1): GroupNorm(32, 128, eps=1e-05, affine=True)

(conv1): Conv2d(128, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

(conv_shortcut): Conv2d(128, 64, kernel_size=(1, 1), stride=(1, 1))

)

(2): ResnetBlock2D(

(norm1): GroupNorm(32, 96, eps=1e-05, affine=True)

(conv1): Conv2d(96, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

(conv_shortcut): Conv2d(96, 64, kernel_size=(1, 1), stride=(1, 1))

)

)

(upsamplers): ModuleList(

(0): Upsample2D(

(conv): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

)

)

)

(2): UpBlock2D(

(resnets): ModuleList(

(0): ResnetBlock2D(

(norm1): GroupNorm(32, 96, eps=1e-05, affine=True)

(conv1): Conv2d(96, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=32, bias=True)

(norm2): GroupNorm(32, 32, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(32, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

(conv_shortcut): Conv2d(96, 32, kernel_size=(1, 1), stride=(1, 1))

)

(1): ResnetBlock2D(

(norm1): GroupNorm(32, 64, eps=1e-05, affine=True)

(conv1): Conv2d(64, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=32, bias=True)

(norm2): GroupNorm(32, 32, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(32, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

(conv_shortcut): Conv2d(64, 32, kernel_size=(1, 1), stride=(1, 1))

)

(2): ResnetBlock2D(

(norm1): GroupNorm(32, 64, eps=1e-05, affine=True)

(conv1): Conv2d(64, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=32, bias=True)

(norm2): GroupNorm(32, 32, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(32, 32, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

(conv_shortcut): Conv2d(64, 32, kernel_size=(1, 1), stride=(1, 1))

)

)

)

)

(mid_block): UNetMidBlock2D(

(attentions): ModuleList(

(0): AttentionBlock(

(group_norm): GroupNorm(32, 64, eps=1e-05, affine=True)

(query): Linear(in_features=64, out_features=64, bias=True)

(key): Linear(in_features=64, out_features=64, bias=True)

(value): Linear(in_features=64, out_features=64, bias=True)

(proj_attn): Linear(in_features=64, out_features=64, bias=True)

)

)

(resnets): ModuleList(

(0): ResnetBlock2D(

(norm1): GroupNorm(32, 64, eps=1e-05, affine=True)

(conv1): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

)

(1): ResnetBlock2D(

(norm1): GroupNorm(32, 64, eps=1e-05, affine=True)

(conv1): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(time_emb_proj): Linear(in_features=128, out_features=64, bias=True)

(norm2): GroupNorm(32, 64, eps=1e-05, affine=True)

(dropout): Dropout(p=0.0, inplace=False)

(conv2): Conv2d(64, 64, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

(nonlinearity): SiLU()

)

)

)

(conv_norm_out): GroupNorm(32, 32, eps=1e-05, affine=True)

(conv_act): SiLU()

(conv_out): Conv2d(32, 1, kernel_size=(3, 3), stride=(1, 1), padding=(1, 1))

)

Comme vous pouvez le constater, il y a un peu plus de choses qui se passent ! Il a également beaucoup plus de paramètres que notre BasicUNet :

sum([p.numel() for p in model.parameters()]) # 1,7M contre les ~309k paramètres du BasicUNet

1707009

Nous pouvons reproduire l’entraînement présenté ci-dessus en utilisant ce modèle à la place de notre modèle original. Nous devons passer x et le pas de temps au modèle (ici, nous passons toujours t=0 pour montrer qu’il fonctionne sans ce conditionnement de pas de temps et pour faciliter le code d’échantillonnage, mais vous pouvez également essayer d’introduire (amount*1000) pour obtenir un équivalent de pas de temps à partir du montant de la corruption). Les lignes modifiées sont indiquées par #<<< si vous souhaitez inspecter le code.

# Dataloader (vous pouvez modifier la taille du batch)

batch_size = 128

train_dataloader = DataLoader(dataset, batch_size=batch_size, shuffle=True)

# Combien de fois devrions-nous passer les données en revue ?

n_epochs = 3

# Créer le réseau

net = UNet2DModel(

sample_size=28, # la résolution de l'image cible

in_channels=1, # le nombre de canaux d'entrée, 3 pour les images RVB

out_channels=1, # le nombre de canaux de sortie

layers_per_block=2, # le nombre de couches ResNet à utiliser par bloc UNet

block_out_channels=(32, 64, 64), # Correspondant à peu près à notre exemple UNet de base

down_block_types=(

"DownBlock2D", # un bloc de sous-échantillonnage ResNet normal

"AttnDownBlock2D", # un bloc de sous-échantillonnage ResNet avec auto-attention spatiale

"AttnDownBlock2D",

),

up_block_types=(

"AttnUpBlock2D",

"AttnUpBlock2D", # un bloc de suréchantillonnage ResNet avec auto-attention spatiale

"UpBlock2D", # un bloc de suréchantillonnage ResNet standard

),

)

net.to(device)

# Notre protection contre la perte

loss_fn = nn.MSELoss()

# L'optimiseur

opt = torch.optim.Adam(net.parameters(), lr=1e-3)

# Conserver une trace des pertes pour les visualiser plus tard

losses = []

# La boucle d'entraînement

for epoch in range(n_epochs):

for x, y in train_dataloader:

# Obtenir des données et préparer la version corrompue

x = x.to(device) # Data on the GPU

noise_amount = torch.rand(x.shape[0]).to(device) # Choisir des quantités de bruit aléatoires

noisy_x = corrupt(x, noise_amount) # Créer notre bruit x

# Obtenir la prédiction du modèle

pred = net(noisy_x, 0).sample #<<< En utilisant toujours le pas de temps 0, en ajoutant .sample

# Calculer la perte

loss = loss_fn(pred, x) # Dans quelle mesure la sortie est-elle proche du véritable x "propre" ?

# Rétropropager et mettre à jour les paramètres

opt.zero_grad()

loss.backward()

opt.step()

# Stocker la perte pour plus tard

losses.append(loss.item())

# Afficher la moyenne des valeurs de perte pour cette époque :

avg_loss = sum(losses[-len(train_dataloader):])/len(train_dataloader)

print(f'Finished epoch {epoch}. Average loss for this epoch: {avg_loss:05f}')

# Graphique

fig, axs = plt.subplots(1, 2, figsize=(12, 5))

# Perte

axs[0].plot(losses)

axs[0].set_ylim(0, 0.1)

axs[0].set_title('Loss over time')

# Échantillons

n_steps = 40

x = torch.rand(64, 1, 28, 28).to(device)

for i in range(n_steps):

noise_amount = torch.ones((x.shape[0], )).to(device) * (1-(i/n_steps)) # De haut en bas

with torch.no_grad():

pred = net(x, 0).sample

mix_factor = 1/(n_steps - i)

x = x*(1-mix_factor) + pred*mix_factor

axs[1].imshow(torchvision.utils.make_grid(x.detach().cpu(), nrow=8)[0].clip(0, 1), cmap='Greys')

axs[1].set_title('Generated Samples')

Finished epoch 0. Average loss for this epoch: 0.018925

Finished epoch 1. Average loss for this epoch: 0.012785

Finished epoch 2. Average loss for this epoch: 0.011694

Ces résultats sont bien meilleurs que notre première série de résultats ! Vous pouvez envisager de modifier la configuration du Unet ou de prolonger l’entraînement afin d’obtenir des performances encore meilleures.

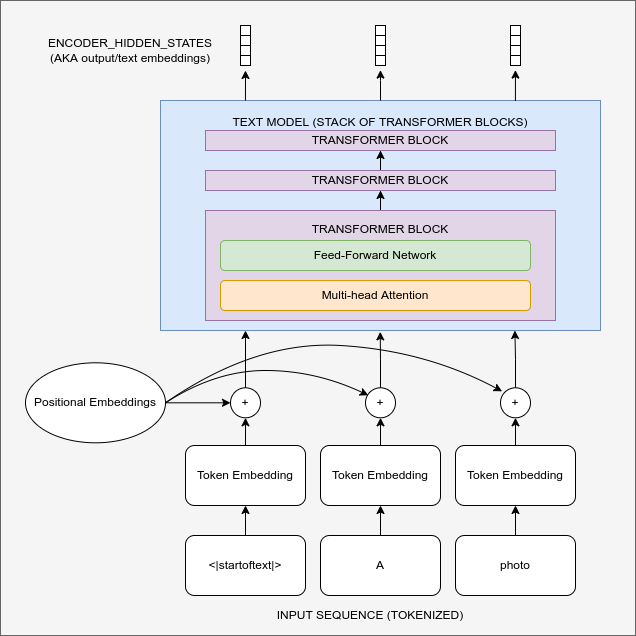

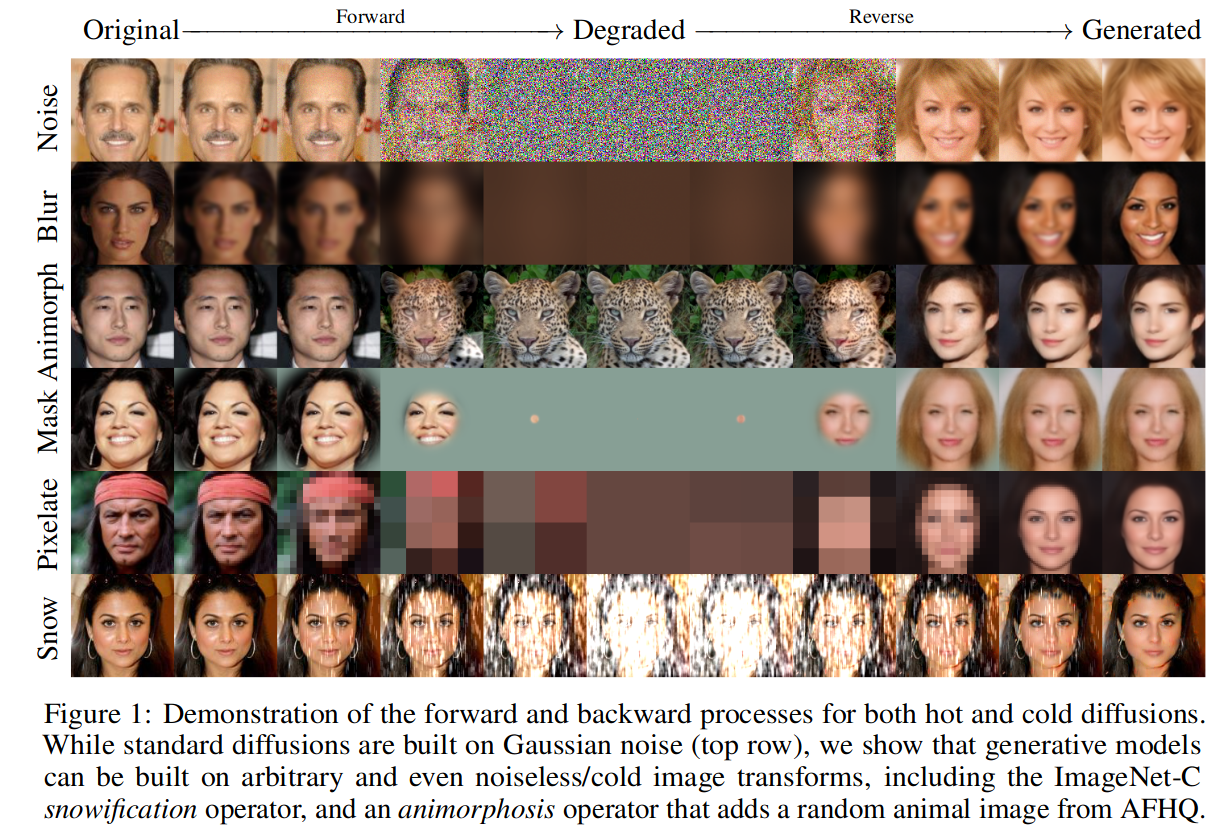

Le processus de corruption

Le papier DDPM décrit un processus de corruption qui ajoute une petite quantité de bruit à chaque « pas de temps ». Étant donné $x_{t-1}$ pour un certain pas de temps, nous pouvons obtenir la version suivante (légèrement plus bruitée) $x_t$ avec :

\[\begin{aligned} q(\mathbf{x}_t \vert \mathbf{x}_{t-1}) &= \mathcal{N}(\mathbf{x}_t; \sqrt{1 - \beta_t} \mathbf{x}_{t-1}, \beta_t\mathbf{I}) \\ q(\mathbf{x}_{1:T} \vert \mathbf{x}_0) &= \prod^T_{t=1} q(\mathbf{x}_t \vert \mathbf{x}_{t-1}) \end{aligned}\]Nous prenons $x_{t-1}$, l’échelonnons de $\sqrt{1 - \beta_t}$ et ajoutons du bruit échelonné de $\beta_t$.

Ce $\beta$ est défini pour chaque t en fonction d’un certain planificateur, et détermine la quantité de bruit ajoutée par pas de temps.